En los últimos años estamos viviendo un auge de la Ciencia de Datos como disciplina, con cada vez más aplicaciones en los más diversos sectores económicos.

El concepto como tal no es nuevo. La estadística ha sido desde hace mucho una herramienta esencial en Ciencias Sociales y ámbitos más técnicos como el diseño de experimentos y el control de calidad.

El objetivo siempre ha sido el mismo, describir la realidad de forma objetiva, anticipando posibles escenarios para poder fundamentar nuestras decisiones.

Este enfoque inicial más “estadístico” ha ido evolucionando con el tiempo.

- Se han incorporado nuevas técnicas desde otros ámbitos técnico-científicos.

- La computación ha incrementado la capacidad de cálculo disponible.

Todo ello termina de “explotar” con la revolución 4.0. El abaratamiento de sensores y comunicaciones ha permitido acumular muchísima más información para trabajar, y nuevas formas de procesarla. Es así como hemos ido pasando de la estadística a la minería de datos, el posterior “Big Data” y más recientemente el “Machine Learning”.

Se abre un nuevo nicho de oportunidades

Al principio era algo exótico. Casos como el de físicos de partículas que se reciclaban desde centros de investigación como el CERN a sectores tan diferentes como el marketing, las ciencias sociales o incluso el fútbol profesional. Tenéis un excelente ejemplo en este vídeo, del siempre recomendable divulgador Javier Santolaya “¿Para qué quiere Guardiola 4 ASTROFÍSICOS en el Manchester City?”

A día de hoy ya hay muchas instituciones y universidades que ofertan grados, cursos y hasta especialidades centradas en la denominada “Ciencia de Datos”. Se trata de formar a profesionales con todos los fundamentos estadísticos, informáticos y matemáticos para desarrollar su actividad en los más diversos sectores.

Y en la industria… ¿Qué llega de todo esto?

Este tipo de tecnologías de tratamiento de datos llevan ya años aplicándose en ámbitos muy concretos donde la digitalización ha alcanzado un nivel de madurez y confianza elevado. Un ejemplo ya clásico es la visión artificial, donde el Machine Learning se aplica por ejemplo a control de calidad. Otros casos más avanzados son los AGV, cada vez más extendidos en industrias y almacenes logísticos; o el reconocimiento facial aplicado a controles de acceso y seguridad.

Con el tiempo son más las industrias que se interesan en ampliar los horizontes. Sacar partido de los datos de proceso, que llevan ya años acumulando en sus históricos, suele ser un tema de interés recurrente. Sin embargo, al tratarse éste de un ámbito más disperso, puede resultar difícil formular iniciativas concretas que ofrezcan un retorno claro.

Los desafíos suelen venir de varios ámbitos

- ¿Tengo realmente suficientes datos para poder trabajar sobre ellos? (en caso contrario, es necesario ampliar la sensorización y captación de datos)

- ¿Son realmente de calidad mis datos? (entiéndase por “calidad” la precisión, regularidad y confiabilidad de éstos)

- ¿Tengo claro qué quiero buscar en mis datos? No es una cuestión baladí. Cualquier análisis de datos debe enfocarse con un objetivo concreto. Esto exige una profunda reflexión desde el punto de vista de negocio y del conocimiento que tengamos del propio proceso. Los temas más habituales aquí suelen ser:Optimizar consumos

- Optimizar la calidad de nuestro producto

- Anticipar averías o fallos de la maquinaria

- Realizar simulaciones del tipo “qué pasaría si…”

¿Tengo las herramientas y capacidades para acometer este tipo de análisis? Evidentemente, no estamos hablando de utilizar Excel para consultar información de nuestra base de datos. Necesitaremos herramientas y habilidades más avanzadas.

¿La estrategia que apoyamos desde Opertek?

Desde Opertek entendemos que se debe comenzar por plantear proyectos piloto, pero teniendo claro que el foco no debe ser validar la tecnología como tal. Si estamos utilizando proveedores consolidados como GE Digital, asumimos que la tecnología base es creíble. El punto clave ha de ser validar si nuestra organización y nuestros sistemas están suficientemente maduros para formular un caso de uso concreto, con un retorno cuantificable de la inversión.

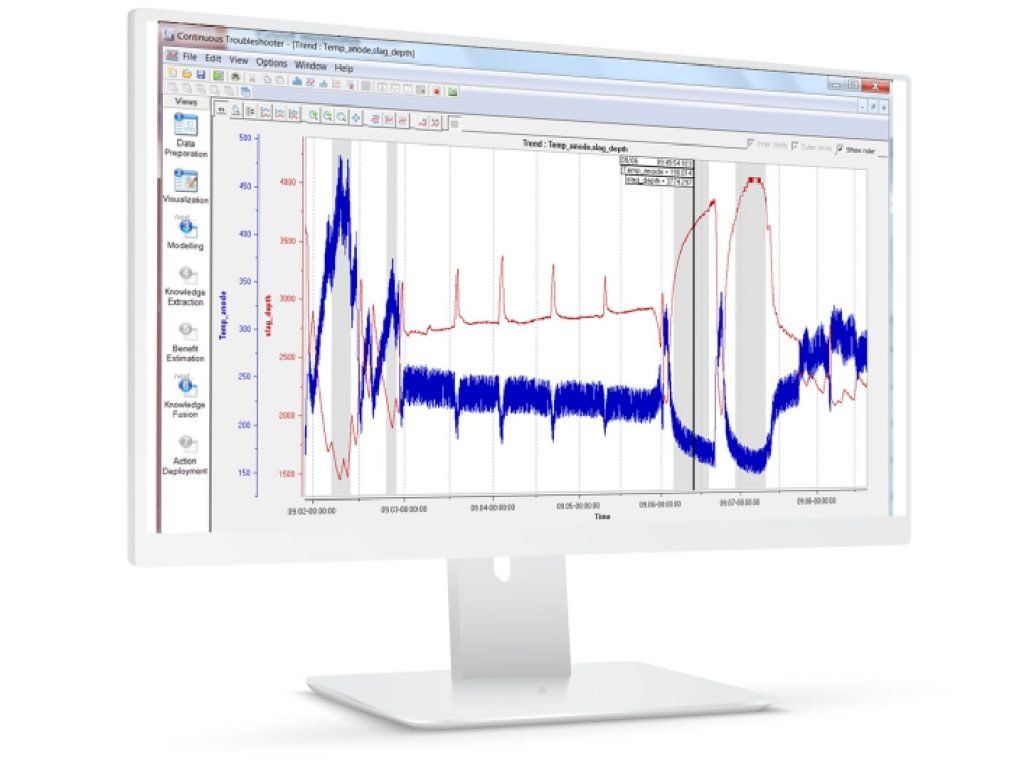

En Opertek ponemos al alcance de nuestros Clientes toda la tecnología imprescindible para aplicar la Ciencia de Datos en la Industria. Desde la automatización básica (captación de datos de proceso) como de historización o el análisis avanzado utilizando técnicas estadísticas, de creación de modelos o Inteligencia artificial. En este último ámbito tenemos CSense. Una solución software que cubre todo lo necesario para que un ingeniero de procesos o de automatización sea autosuficiente en materia de Ciencia de Datos.

Creemos que es clave empoderar a nuestro propio personal técnico y no depender de terceros para desarrollar estas iniciativas. Al fin y al cabo, es nuestro propio personal el que conoce perfectamente el proceso, y tiene la intuición necesaria para saber qué tiene sentido buscar y cómo hay que plantearlo para poder obtener un retorno claro. Depender de científicos de datos externos nos puede hacer perder una perspectiva imprescindible para obtener resultados, por muy completas y avanzadas que sean las técnicas que puedan ofrecernos estos expertos externos.

¿Te interesa saber más de CSense y las posibilidades que ofrece GE Digital para trasladar a la industria todo el poder de la Ciencia de Datos? ¡Contacta con Opertek !.

¿Te interesa este tema?

Habla con nuestro equipo de expertos en automatización industrial.

Contactar con un experto